Pflanzenbestimmung mit Künstlicher Intelligenz

Von Spargel-Weihnachtsbäumen und den Vorzügen von Ensemble-Vorhersagen im Maschinellen Lernen

Hast du schonmal eine dieser KI-Apps ausprobiert, die nur anhand eines Handy-Fotos einer Pflanze ihre Art bestimmen? Klingt nach einem ziemlich coolen Werkzeug für alle, die sich für Natur interessieren und im Pflanzenbestimmungskurs nicht aufgepasst haben. Vor einiger Zeit habe ich daher angefangen, mit solchen Apps herumzuspielen, um (1) mit ihnen Unfug zu machen und (2) wenn das nicht klappt, beim Wandern die eine oder andere Pflanzenart zu entdecken.

Nun ja, zum Glück habe ich es geschafft, Unfug damit zu machen, denn beim Wandern mit schwerem Rucksack habe ich nur zu selten die Geduld, das Handy zu zücken, überlebenswichtigen Akku zu verschwenden, und mich zum Fotografieren zu bücken während mein Mitwanderer steten Schrittes davontrottet…

Figure 1: Einem Enzian in den Pyrenäen auf der Spur. Foto (c) Stefan Lüdke 2021.

So blieb es also beim Unfug und den Lektionen, die man aus diesen über Maschinelles Lernen und Künstliche Intelligenz lernen kann.

Das fing wohl damit an, dass ich als Allererstes die für etwa $5 erstandene App namens Plant Identifier 1.4 an unserem Lehrstuhl-Weihnachtsbaum aus Plastik ausprobierte, mit goldenem und rotem Schmuck mitten im Bild. Im Handumdrehen spuckte die App aus, dass es sich wohl um einen Gemeinen Wacholder handeln muss – mit goldenen, faustgroßen Früchten, echt jetzt? Oder um eine Douglasie. Oder dann doch eine Eibe, jetzt aber wirklich, mit einer accuracy von 67,21%.

Figure 2: Der künstliche Lehrstuhl-Weihnachtsbaum ist also eine Gemeine Eibe?

Mit der Zeit kamen Versuche an Plastikpflanzen in rumänischen Hotels dazu – z.B. einem prächtigen Madeira-Natternkopf (accuracy: 77,52%, wow!), jedenfalls behauptete das die App.

Erst nach den Weihnachtstagen 2021 packte mich jedoch ein wenig wissenschaftlicher Ehrgeiz und ich sah mir die Fähigkeiten der App ein bisschen systematischer an… anhand unseres dekorierten Weihnachtsbaums, einer Nordmann-Tanne.

Um bei allem Jux fair zu sein, sei gleich hier angemerkt: Ich bin eigentlich begeistert von dieser App und anderen, die ich nur mal kurz ausprobiert habe, namentlich Flora Incognita von der TU Ilmenau und PlantNet von einem französischen Forschungskonsortium. Sie alle liefern erstaunlich gute Ergebnisse. Ich beschränke mich hier aber auf Plant Identifier 1.4 für Android von TAPCURATE, weil es irre einfach zu bedienen ist: Foto machen, fertig. Für die Bedienung der PlantNet-App bin ich dagegen offenbar zu doof, und Flora Incognita ist mir zu akademisch: ich hätte im Gelände keine Lust, in einen Dornbusch hineinzukriechen, um seine Rinde bildfüllend zu fotografieren, und zwar bitte auf Brusthöhe. (Okay, ich glaube das könnte man überspringen.) Eine aktuelle Übersicht über ähnliche Apps gibt es bei lifewise.com.

Eine semi-wissenschaftliche Analyse

Also, jetzt zur semi-wissenschaftlichen Inspektion von Plant Identifier 1.4 zur Identifikation einer Nordmann-Tanne unter realen Geländegerödel-Bedingungen im nachweihnachtlichen Wohnzimmer. Hierzu gehören durchwachsene Beleuchtungsverhältnisse (Lichterkette an, draußen dunkel; Lichterkette aus, Sonne scheint rein), variierende Motive (Kugeln, Engel, … und äh… ja, auch Zweige und Stamm). Das klingt zunächst unfair, aber wer schonmal in einem echten, dichten Waldbestand war, der weiß, dass dort Zweige von Nachbarbäumen hineinragen können, Unterwuchs, Vogelnester, Stacheldrahtzaun. Auch hat sich die App nie über die Qualität meiner Bilder beschwert – also muss sie auch mit meinen suboptimalen Studienbedingungen zurechtkommen.

So nahm ich also unter den fragenden Blicken meiner Familie nach und nach 69 Fotos dieser stolzen Nordmann-Tanne (Abies nordmanniana) auf, und sieh da: es handelt sich in Wirklichkeit um einen Feder-Spargel. Nein, Granatapfel. Oder doch eine peruanische Cantuta? Vielleicht eine Japanische Stechpalme oder eine neukaledonische Araukarien-Art? All das wurde auch ausgespuckt, doch allen voran die Nordmann-Tanne (48%) und die ähnliche (aber in Deutschland nur selten als Weihnachtsbaum genutzte) Edel-Tanne (25%).

Hier eine Übersicht aller Ergebnisse für die dekorierte Nordmann-Tanne:

| Art laut App | Häufigkeit | Mittlere accuracy | Maximale accuracy |

|---|---|---|---|

| Nordmann-Tanne (Abies nordmanniana) | 33 | 37.32 | 70.41 |

| Edel-Tanne (Abies procera) | 17 | 34.16 | 62.74 |

| Hinoki-Scheinzypresse (Chamaecyparis obtusa) | 6 | 29.22 | 53.07 |

| Neuguinea-Araukarie (Araucaria cunninghamii) | 2 | 34.42 | 41.32 |

| Araucaria columnaris (Araucaria columnaris) | 2 | 13.62 | 25.65 |

| Feder-Spargel (Asparagus setaceus) | 1 | 32.44 | 32.44 |

| Pracht-Tanne (Abies magnifica) | 1 | 35.77 | 35.77 |

| Granatalpfel (Punica granatum) | 1 | 40.28 | 40.28 |

| Cantua (Cantua buxifolia) | 1 | 41.97 | 41.97 |

| Norfolk-Tanne (Araucaria heterophylla) | 1 | 13.84 | 13.84 |

| Beschuppter Wacholder (Juniperus squamata) | 1 | 17.17 | 17.17 |

| Japanische Stechpalme (Ilex crenata) | 1 | 21.46 | 21.46 |

| Purpur-Tanne (Abies amabilis) | 1 | 56.42 | 56.42 |

| Gemeine Eibe (Taxus baccata) | 1 | 24.40 | 24.40 |

Adversarial attacks

Wie würde es weitergehen, wenn ich weiter drauf los fotografieren würde? Oder wenn ich ein bisschen mit dem Schmuck spielen würde? Würde irgendwann auch mal ein Foto als Säulenkaktus oder als Gänseblümchen klassifiziert werden? Kann ich das vielleicht sogar durch gezielte, kaum erkennbare Bildmanipulation herbeiführen?

Vielleicht. So etwas nennt man in der KI-Forschung eine adversarial attack, also einen “feindlichen Angriff”.

Fluch und Segen von Kontextinformationen in der KI

Ob der Weihnachtsbaum-Schmuck nun dabei behilflich oder eher hinderlich war, ausgerechnet zwei Weihnachtsbaumarten so weit oben zu platzieren, lässt sich nur spekulieren. Für eine Gegenprobe ohne Schmuck ist es leider inzwischen zu spät.

Manche Apps verwenden übrigens auch Kontextinformationen wie zum Beispiel den Standort, um bei Wildpflanzen exotische Arten auszuschließen. Allerdings besteht dabei die Gefahr, eingeschleppte Pflanzen nicht zu erkennen, weil das KI-System sie hier nicht erwartet – das kann natürlich auch uns Menschen passieren. Solche potenziell nützlichen Informationen über die a priori-Wahrscheinlichkeit einer Art in einem bestimmten Kontext können also auch den Blick auf Neues versperren und sind somit ein zweischneidiges Schwert: sie sind Wissensvorsprung und Vorurteil zugleich.

Mit Ensemble-Methoden Klassifikationen verbessern

Nun waren die mit nur einem Foto erzielten Ergebnisse schon sehr ermutigend, auch wenn die Fehlklassifikationen reichlich Anlass zu Spott geben. Lässt sich die Klassifikation verbessern, indem man die Ergebnisse mehrerer Fotos kombiniert? Welche Strategie ist am erfolgreichsten?

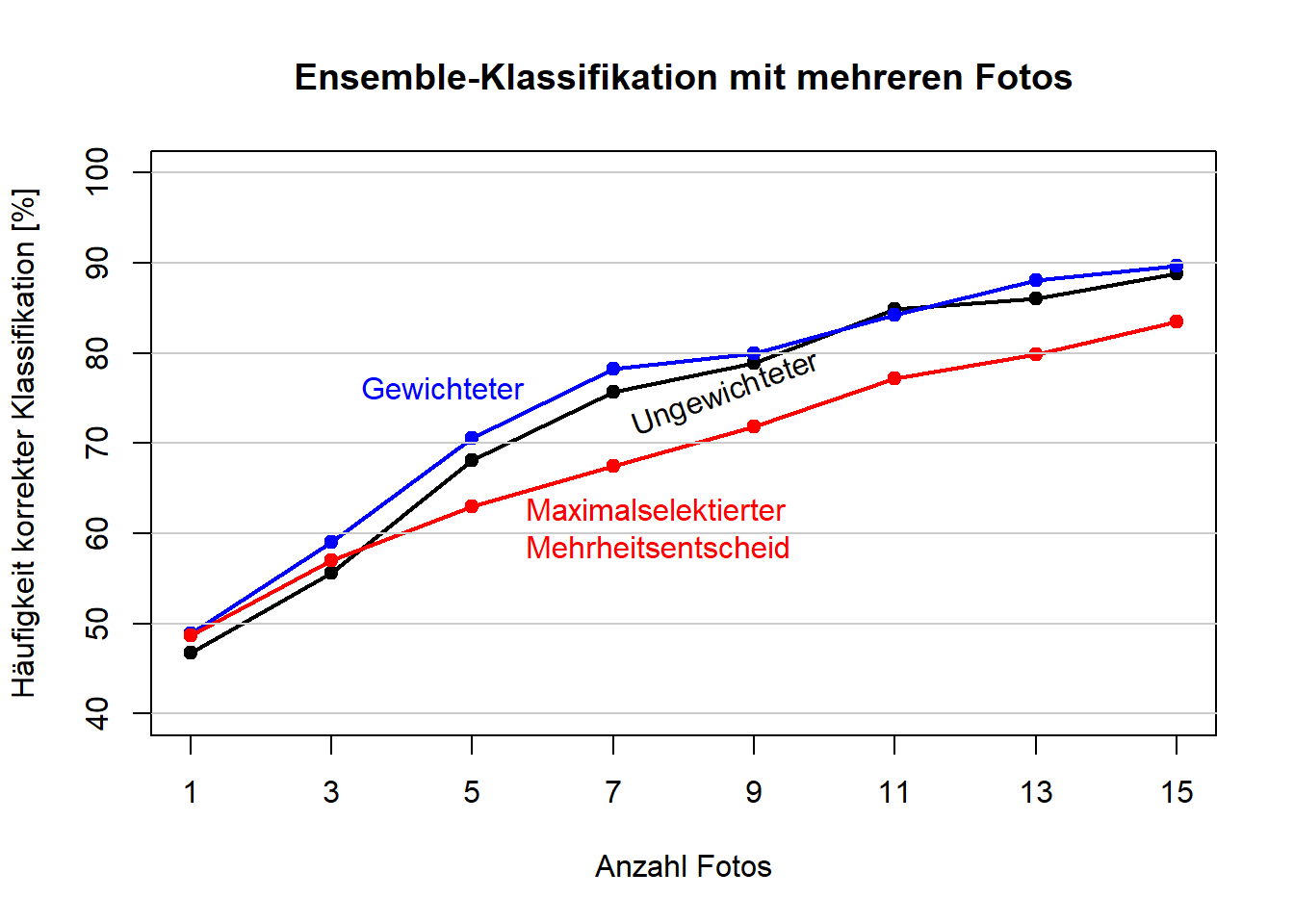

Ein im Maschinellen Lernen verwendeter Ansatz besteht darin, auf der Grundlage mehrerer Klassifikationsergebnisse eine Mehrheitsentscheidung zu treffen. Diese Strategie ist die Grundlage äußerst erfolgreicher Verfahren wie des 2001 von Leo Breiman entwickelten Random Forest. Doch anstelle eines reinen Mehrheitsentscheids wäre es auch denkbar, die einzelnen Klassifikationsergebnisse nach ihrer Qualität (accuracy) zu gewichten, uneindeutige Fotos somit weniger stark zu berücksichtigen. Und schließlich könnte man auch einfach diejenige Klassifikation auswählen, die die höchste accuracy erzielt hat (“Maximalselektion”).

Mit der Weihnachtsbaum-Bilddatenbank lassen sich diese Strategien vergleichen: Wir ziehen zufällig z.B. fünf Fotos (bzw. deren Klassifikationsergebnisse) aus der Datenbank und treffen einen Mehrheitsentscheid nach der gewählten Methode. Das wiederholen wir viele (hier: 2000) Male und berechnen, wie oft beim Mehrheitsentscheid “Nordmann-Tanne” herauskommt:

Figure 3: Zunahme der Klassifikationsgüte mit zunehmender Anzahl verwendeter Fotos für unterschiedliche Ensemble-Verfahren.

Mit nur fünf Fotos lassen sich somit beachtliche Verbesserungen erzielen. Wenn unsere App in der Lage wäre, aus einer Videosequenz eine Reihe unterschiedlicher Fotos der gleichen Pflanze zu extrahieren, könnte man mühelos 10 oder 20 Fotos von unterschiedlichen Pflanzenteilen aufnehmen und damit zumindest bei meinem Weihnachtsbaum eine Erfolgsquote von 90% erzielen. Gewichtete und ungewichtete Mehrheitsentscheide sind dabei vielversprechender als die Maximalselektion.

Diese Strategien lassen noch weiter perfektionieren – so fordern manche Apps Fotos bestimmter Pflanzenteile (z.B. Blätter, Stamm, Blüte) oder der Wuchsform an, wodurch mit einer geringeren Anzahl Fotos (und größerer Sorgfalt) bessere Ergebnisse erzielt werden.

Was haben wir gelernt?

- KI-basierte Apps zur Pflanzenbestimmung in Fotos sind erstaunlich erfolgreich.

- Dennoch: Es kann auch Unfug herauskommen. Ob ich es wohl schaffe, einen Weihnachtsbaum als Gänseblümchen klassifiziert zu bekommen (adversarial attack)?

- Eine Ensemble-Klassifikation mit Hilfe mehrerer Aufnahmen würde die Genauigkeit erheblich verbessern.

- Die Einbeziehung von Kontextinformationen, z.B. Standortdaten, ist ein zweischneidiges Schwert: Vorwissen oder Vorurteil?

Weiterführende Links und Literatur

Über die von mir genutzte App Plant Identifier gibt es leider nur wenige Hintergrundinfos, aber…:

- PlantNet ist eine hervorragende App und Web-Plattform für die Pflanzenbestimmung mit KI. Einen Überblick über die Architektur von PlantNet gibt ein Artikel von Affouard et al. (2017) in ICLR.

- Aus PlantNet ist eine Buchpublikation hervorgegangen, die die wissenschaftlichen Hintergründe im Detail darstellt, etwa in diesem Kapitel.